ロボティクスと機械学習の融合領域である「ロボット学習」に取り組んでいます. 特に, エージェントが環境と相互作用しながらタスクを達成するための最適な行動を学習する強化学習を中心に, 実環境で機能する方策の学習と, 複数方策を活用した高効率な学習に関する研究を進めています.

大規模並列強化学習における方策多様性の制御

ICLR 2026 To Appear (Poster)

数万並列シミュレーション環境において, 複数の方策を用いて多様なサンプルを収集するアンサンブル型方策勾配法は, 探索を促進する手法として提案されてきた. しかし、過度な探索は探索の質を低下させたり、学習の安定性を損なったりする可能性があるため, 探索空間を単に広げるだけでは必ずしも学習能力の向上につながらない.

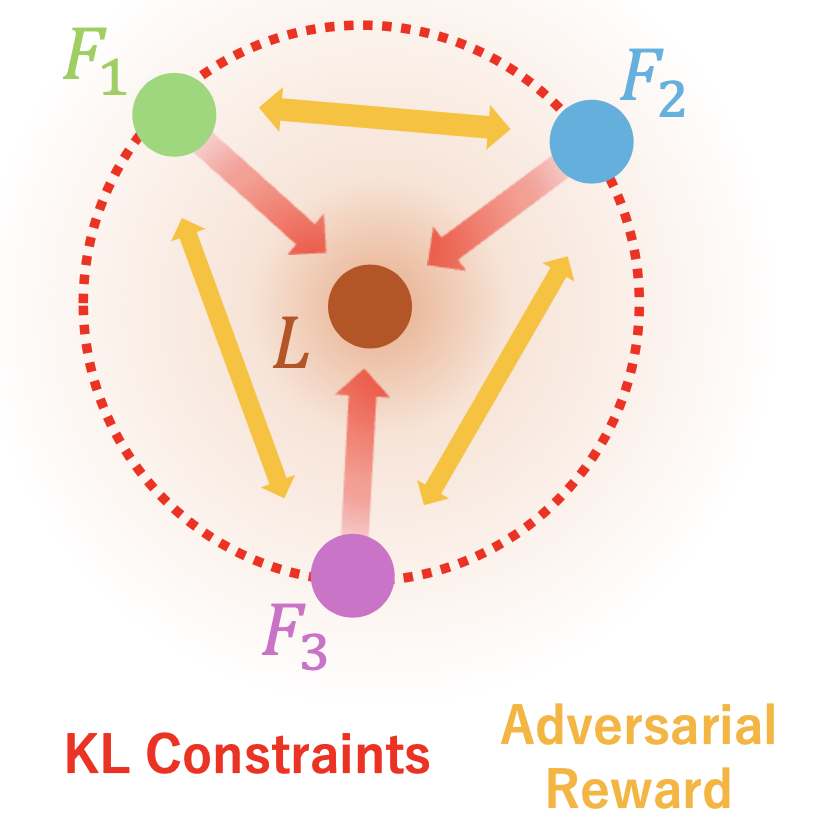

本研究では, 方策アンサンブルにおける方策間の多様性が学習効率に与える影響を理論的に解析し, 方策間の KL 制約によって多様性を制御する Coupled Policy Optimization(CPO)を提案した. 提案手法はリーダー方策の近傍をフォロワー方策が探索する効果的な探索を実現し, 複数のロボット物体操作タスクにおいてサンプル効率および最終性能の両面で強力なベースラインを上回る性能を示した. さらに理論的分析により, リーダー・フォロワーの乖離がリーダー方策の学習に与える影響と, KL制約が方策乖離に与える影響を示した.

Naoki Shitanda, Motoki Omura, Tatsuya Harada, Takayuki Osa. "Rethinking Policy Diversity in Ensemble Policy Gradient in Large-Scale Reinforcement Learning." International Conference on Learning Representations (ICLR), 2026 (To Appear, Poster).

[プロジェクトページ] [Arxiv] [OpenReview] [研究室ページ] [理研AIPニュース]